DeepFake dünyanın en tehlikeli silahına dönüşebilir mi?

DeepFake videoları ile insanların yüz görüntülerini herhangi başka bir videoya eklemek ve videoyu gerçekmiş gibi bir algı oluşturmak mümkün oluyor. Bu nedenle kendi yüzünüzü bir porno filminde veya bir terör örgütünün çektiği katliam videolarında insanları katlederken görmeniz mümkün.

Twitter bu teknolojinin insanları taciz ve mağdur etmek için kullanılacağına emin. Üstelik bu videoların Twitter üzerinden yayınlanacağı da kesin. Dolayısıyla videoları tespit edecek bir teknoloji geliştiren Twitter artık tespit ettiği videoların altına “bu video sentetik olarak üretilmiştir ve gerçek olmayabilir,” ifadesini yerleştirecek

Ayrıca bu videoları paylaşan insanlara da öncelikle bir uyarı çıkaracak ve videonun sahte olduğunu hatırlatacak. Son olarak da videoyu ilk kez yükleyen hesabın bilgileri verilecek ve bu manipülasyonu kimin yaptığı bilinecek.

Twitter’ın alacağı önlemler, DeepFake teknolojsii ile insanlara itibar linci yapmak isteyen grupları durdurabilir mi? Ya da bu videolarla toplumları şekillendirip yanlış yönlendirerek isyanlar çıkarmak isteyenler engellenebilir mi?

Örneğin, Hindistan’da geçtiğimiz yıl bir aile, düşman olduğu komşuları hakkında internette “tecavüzcü” olduklarını iddia eden bir video yayınlamış ve ardından yüzlerce öfkeli insanın bu kişileri linç ederek öldürmelerini sağlamışlardı. Olay BBC tarafından da detaylıca incelenmiş, sosyal medyanın nasıl ölümcül bir silah olarak kullanılabileceğine örnek olarak gösterilmişti.

DeepFake gibi yapay zekalı videolarla şimdi bu tür bireysel suçlar kadar ülkelerin kaderlerini değiştirecek operasyonları da hayata geçirmek kolaylaşacak.

SON DAKİKA

EN ÇOK OKUNANLAR

Radyoyu Kim İcat Etti? Radyo Nasıl ve Ne Zaman İcat Edilidi?

Uçağı Kim İcat Etti? İlk Uçak Ne Zaman, Nasıl Bulundu? Uçağın Mucitleri Kimdir?

Televizyonu Kim İcat Etti? Geçmişten Günümüze Televizyonun Yolculuğu

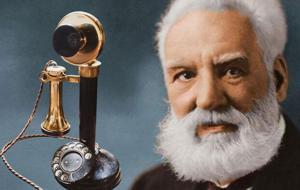

Telefonu Kim İcat Etti? 1876’da Başlayan Bir Hikaye!

iPhone'u olanlar dikkat! Apple'dan uyarı geldi: Cihazlar tehdit altında